교차 검증

1. k-fold

from sklearn.model_selection import KFold

iris = load_iris()

features = iris.data

label = iris.target

dt_clf = DecisionTreeClassifier(random_state=156)

# 5개의 폴드 세트로 분리하는 KFold 객체와 폴드 세트별 정확도를 담을 리스트 객체 생성.

kfold = KFold(n_splits=5)

cv_accuracy = []

n_iter = 0

# KFold객체의 split( ) 호출하면 폴드 별 학습용, 검증용 테스트의 로우 인덱스를 array로 반환

for train_index, test_index in kfold.split(features):

# kfold.split( )으로 반환된 인덱스를 이용하여 학습용, 검증용 테스트 데이터 추출

X_train, X_test = features[train_index], features[test_index]

y_train, y_test = label[train_index], label[test_index]

#학습 및 예측

dt_clf.fit(X_train , y_train)

pred = dt_clf.predict(X_test)

n_iter += 1

# 반복 시 마다 정확도 측정

accuracy = np.round(accuracy_score(y_test,pred), 4)

train_size = X_train.shape[0]

test_size = X_test.shape[0]

print('\n#{0} 교차 검증 정확도 :{1}, 학습 데이터 크기: {2}, 검증 데이터 크기: {3}'

.format(n_iter, accuracy, train_size, test_size))

print('#{0} 검증 세트 인덱스:{1}'.format(n_iter,test_index))

cv_accuracy.append(accuracy)

# 개별 iteration별 정확도를 합하여 평균 정확도 계산

print('\n## 평균 검증 정확도:', np.mean(cv_accuracy))2. stratified k-fold

k-fold 와 다른점 : label 값을 반드시 설정해주어야 한다.

from sklearn.model_selection import StratifiedKFold

skf = StratifiedKFold(n_splits=3)

n_iter=0

for train_index, test_index in skf.split(iris_df, iris_df['label']):

n_iter += 1

label_train= iris_df['label'].iloc[train_index]

label_test= iris_df['label'].iloc[test_index]

print('## 교차 검증: {0}'.format(n_iter))

print('학습 레이블 데이터 분포:\n', label_train.value_counts())

print('검증 레이블 데이터 분포:\n', label_test.value_counts())

dt_clf = DecisionTreeClassifier(random_state=156)

skfold = StratifiedKFold(n_splits=3)

n_iter=0

cv_accuracy=[]

# StratifiedKFold의 split( ) 호출시 반드시 레이블 데이터 셋도 추가 입력 필요

for train_index, test_index in skfold.split(features, label):

# split( )으로 반환된 인덱스를 이용하여 학습용, 검증용 테스트 데이터 추출

X_train, X_test = features[train_index], features[test_index]

y_train, y_test = label[train_index], label[test_index]

#학습 및 예측

dt_clf.fit(X_train , y_train)

pred = dt_clf.predict(X_test)

# 반복 시 마다 정확도 측정

n_iter += 1

accuracy = np.round(accuracy_score(y_test,pred), 4)

train_size = X_train.shape[0]

test_size = X_test.shape[0]

print('\n#{0} 교차 검증 정확도 :{1}, 학습 데이터 크기: {2}, 검증 데이터 크기: {3}'

.format(n_iter, accuracy, train_size, test_size))

print('#{0} 검증 세트 인덱스:{1}'.format(n_iter,test_index))

cv_accuracy.append(accuracy)

# 교차 검증별 정확도 및 평균 정확도 계산

print('\n## 교차 검증별 정확도:', np.round(cv_accuracy, 4))

print('## 평균 검증 정확도:', np.mean(cv_accuracy))3. corss_val_score()

폴드 세트 추출, 학습/예측, 평가를 한번에 수행한다.

corss_val_score(estimator, X, y=None, scoring=None, cv=None, n_jobs=1, verbose=0, fit_params=None.pre_dispatch='2*n_jobs')

estimator : 분류/회귀의 클래스

X : feature 데이터셋

y : label 데이터셋

scoring : 평가를 어떤 것으로 할것이냐? (정확도, ROC-AOC)

from sklearn.tree import DecisionTreeClassifier

from sklearn.model_selection import cross_val_score , cross_validate

from sklearn.datasets import load_iris

import numpy as np

iris_data = load_iris() # 데이터 로드

dt_clf = DecisionTreeClassifier(random_state=156) # classifier 생성

data = iris_data.data # 피쳐 데이터셋 설정

label = iris_data.target # 레이블 데이터셋 설정

# 성능 지표는 정확도(accuracy) , 교차 검증 세트는 3개

scores = cross_val_score(dt_clf , data , label , scoring='accuracy',cv=3) # 평가 = 정확도

# cv = 교차검증세트 수

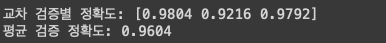

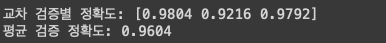

print('교차 검증별 정확도:',np.round(scores, 4))

print('평균 검증 정확도:', np.round(np.mean(scores), 4))

4. GridSearchCV

격자처럼 꼼꼼하게 교차 검증과 최적 하이퍼 파라미터 튜닝을 한번에 한다.

하이퍼 파라미터 : 머신러닝 알고리즘을 튜닝하는 파라미터

ex) max_depth, min_samples_split 등의 각각의 파라미터 값을 넣어보면서 최적의 파라미터 값을 찾는다.

만약 max_depth = [1,2,3] 이고 min_samples_split = [2,3] 이고, cv 세트가 3이라면

6(파라미터 순차 적용 횟수) x 3(cv 세트 수) = 18 (학습/검증 총 수행 횟수)

from sklearn.datasets import load_iris

from sklearn.tree import DecisionTreeClassifier

from sklearn.model_selection import GridSearchCV, train_test_split

from sklearn.metrics import accuracy_score

# 데이터를 로딩하고 학습데이타와 테스트 데이터 분리

iris = load_iris()

X_train, X_test, y_train, y_test = train_test_split(iris_data.data, iris_data.target,

test_size=0.2, random_state=121)

dtree = DecisionTreeClassifier()

### parameter 들을 dictionary 형태로 설정

parameters = {'max_depth':[1, 2, 3], 'min_samples_split':[2,3]}

import pandas as pd

# param_grid의 하이퍼 파라미터들을 3개의 train, test set fold 로 나누어서 테스트 수행 설정.

### refit=True 가 default 임. True이면 가장 좋은 파라미터 설정으로 재 학습 시킴.

grid_dtree = GridSearchCV(dtree, param_grid=parameters, cv=3, refit=True, return_train_score=True)

# 붓꽃 Train 데이터로 param_grid의 하이퍼 파라미터들을 순차적으로 학습/평가 .

grid_dtree.fit(X_train, y_train)

# GridSearchCV 결과는 cv_results_ 라는 딕셔너리로 저장됨. 이를 DataFrame으로 변환

scores_df = pd.DataFrame(grid_dtree.cv_results_)

scores_df[['params', 'mean_test_score', 'rank_test_score',

'split0_test_score', 'split1_test_score', 'split2_test_score']]GridSearchCV()의 파라미터는 무조건 리스트 형태로 넣어주어야 한다.

refit=True : GridSearchCV가 하이퍼파라미터를 찾아내면 그 파라미터를 최종적으로, estimator를 학습시킨다.

return_train_score=True : train score를 가져오기 위해 쓰는 것

그 후, fit을 하는 순간, 위의 파라미터들을 순차적으로 계속 돌아가면서 cv 세트 3에 맞춰서 계속 수행하게 된다.

즉 18번 수행하게 된다.

이 18번 수행된 결과가 cv_results_ 에 저장된다. 딕셔너리 형태이다.

mean_test_score 는 cv를 3번 수행했을 때의 accuracy의 평균값이다.

rank_test_score 는 그때의 랭크이다.

따라서 가장 좋은 파라미터가 무엇인지 알 수 있다.

print('GridSearchCV 최적 파라미터:', grid_dtree.best_params_)

print('GridSearchCV 최고 정확도: {0:.4f}'.format(grid_dtree.best_score_))

# refit=True로 설정된 GridSearchCV 객체가 fit()을 수행 시 학습이 완료된 Estimator를 내포하고 있으므로 predict()를 통해 예측도 가능.

pred = grid_dtree.predict(X_test)

print('테스트 데이터 세트 정확도: {0:.4f}'.format(accuracy_score(y_test,pred)))

최적의 파라미터와, 최고 정확도를 알 수 있다.

또한 그 최적의 파라미터로 학습된 모델을 테스트 데이터로 학습했을 때의 정확도도 비슷하게 나오는 것을 확인할 수 있다.

# GridSearchCV의 refit으로 이미 학습이 된 estimator 반환

estimator = grid_dtree.best_estimator_

# GridSearchCV의 best_estimator_는 이미 최적 하이퍼 파라미터로 학습이 됨

pred = estimator.predict(X_test)

print('테스트 데이터 세트 정확도: {0:.4f}'.format(accuracy_score(y_test,pred)))

그리고 fit()을 하면 학습까지 된다고 했는데, 여기서 최적의 파라미터로 설정된 모델을 best_estimator_ 로 반환할 수 있다.

'💡 AI > ML' 카테고리의 다른 글

| ML - 정규화 (0) | 2021.09.15 |

|---|---|

| ML - 레이블 인코딩, 원핫 인코딩 (0) | 2021.09.15 |

| ML - 예측 프로세스 (0) | 2021.08.25 |

| ML - pandas 기본 (0) | 2021.08.24 |

| ML - 머신러닝과 numpy 기본 (0) | 2021.08.23 |